|

||||

|

|

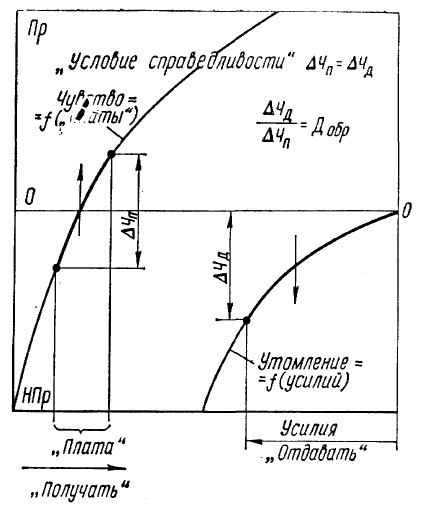

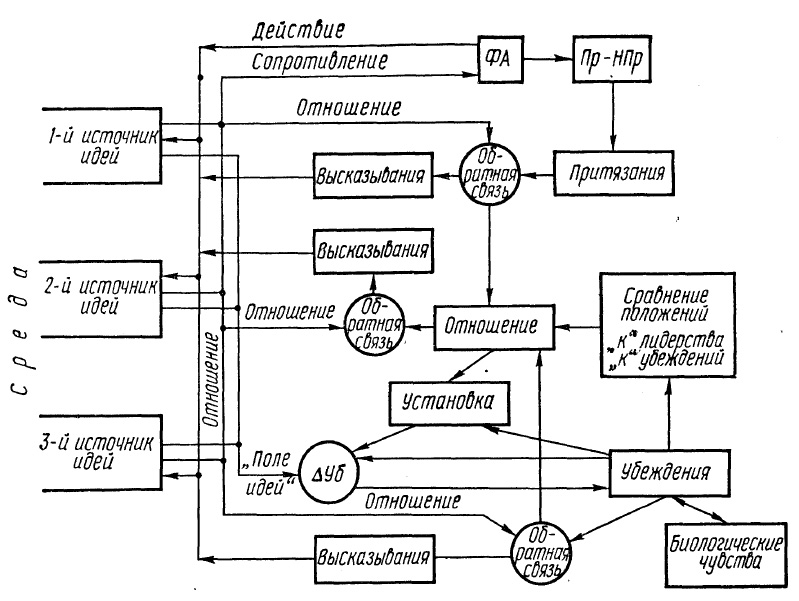

Искусственный интеллект в человеческом обществе Сначала обратимся к искусственному интеллекту, создаваемому для управления сложными системами, либо с целью делать это лучше, чем люди, либо для работы в условиях, где люди не могут существовать. Можно предположить такие примеры: 1. Роботы с интеллектом для работ под водой и в космосе, особенно на Луне и планетах. 2. ИИ для управления технологией. 3. ИИ с комплексом диагностической и управляющей аппаратуры, предназначенный для лечения больных. 4. ИИ для обучения и даже воспитания детей. Физическое воплощение такого воспитателя еще требует проработки. 5. Наконец, ИИ для управления экономикой общества. Кроме первой задачи, все другие требуют очень высокого уровня интеллекта, во всяком случае выше среднего человеческого, но притом ИИ должен обладать еще некоторыми дополнительными качествами, иначе не будет смысла в его применении. Основные «индивидуальные» качества ИИ Для такого ИИ, живущего среди людей, прежде всего нужна речь в самом широком смысле этого слова — устная, письменная, понимание графических и математических моделей. Необходимым качеством должна быть обучаемость, поскольку невозможно обеспечить разумное взаимодействие со сложными динамическими системами без программы постоянного изменения моделей и приспособляемости. Вопрос о воспитуемости как втором проявлении принципа самоорганизации представляется более сложным, и мы его рассмотрим ниже. Предварительно скажу: воспитуемость, то есть способность изменять характеристики заданных изначально потребностей и чувств, нужна обязательно. Уточнения требует лишь ее степень. Человек и животные тоже воспитуемы, но в разных пределах. Разнообразие людей выражается в разнице характеристик врожденных чувств и характера, а также в способностях. В частности, в особенностях элементов памяти. Разнообразие интеллектов, даже одинаково запроектированных, должно возникнуть само собой в результате самоорганизации в процессе деятельности. Уровень сознания ИИ зависит от его назначения. Для подводного робота достаточно и второго уровня, для всех же других «профессий», если их выполнять лучше, чем люди средних возможностей, необходим третий уровень. Врожденные потребности и убеждения являются основными источниками активности, управляющими всеми действиями с моделями. Интеллект всегда утилитарен, даже если он нацелен на совершенно отвлеченные идеи. В ИИ на физических элементах врожденные потребности закладываются в виде «центров» — моделей со специфическими характеристиками, работающими как генераторы активности. В АИ активность — лишь параметр, выражаемый цифрами, но через его изменения осуществляется все регулирование действий с моделями. Изменение «врожденных» характеристик в процессе деятельности — главное проявление воспитуемости. Другим проявлением является создание убеждений. Видимо, для каждого искусственного интеллекта необходима по крайней мере одна специальная потребность — самосохранение. Сюда входят питание и безопасность. Первое проявляется во внешнем энергетическом снабжении, второе — не только в защите и стремлении избегнуть внешней угрозы, но и в «боли» — как сигнале о внутренних неполадках. Любая разумная машина, рассчитанная на самостоятельное существование, должна «ощущать боль» при повреждениях и иметь системы надежности. Внутреннюю «боль» ИИ легко воспроизвести, но внешняя угроза имеет информационный характер и требует программы выделения и распознавания образов угрозы. Потребности самосохранения выражаются в соответствующих чувствах, трактуемых на человеческом языке как голод, боль и страх. Страх — более широкое понятие, чем чувство, вызванное угрозой, действующей в данный момент. Это слово выражает также и чувство от любых будущих воздействий, угрожающих удовлетворению любой потребности. «Боюсь голода, боли, скуки, старости» и «сейчас, в данный момент, боюсь собаки или хулигана» — это не одно и то же. Рабочие потребности и соответствующие им чувства обязательны в искусственном интеллекте высокого ранга. Главная из них — потребность в новизне (или просто любознательность) — особенно важна. Если создавать ИИ-исследователь, то именно это чувство должно стать главным стимулом его поведения. Столь же интересны потребность в деятельности и «рефлекс цели» — они действуют при любом ФА, хотя в большинстве случаев не обеспечивают сколько-нибудь значительных стимулов и не могут создать высокого напряжения действия. Универсальной является потребность в расслаблении и отдыхе как реакция на любую напряженную деятельность. Активность чувства утомления является главным «тормозом» и в значительной мере определяет дееспособность ИИ в любой сфере. Спрашивается, нужно ли вообще задавать это чувство для искусственного интеллекта, призванного общаться с людьми. Мне кажется, что оно выполняет полезные функции, регулируя ФА, определяя расход энергии стимулов. Если его не будет, возможен «разнос», чрезмерное усиление одного вида действий в ущерб другому (особенно, если задано качество тренируемости элементов ИИ). Чувство скуки, ощущение «надоело» сродни утомлению, оно тоже является «тормозом» и ограничивает продолжительность однородной деятельности, требуя переключения, хотя и не связано с расходом энергии. Необходимость такого чувства очевидна, хотя чрезмерное развитие его сделает ИИ бездельником. Потребность в свободе, или «рефлекс свободы», по И. П. Павлову, является источником агрессивности у людей. Как упоминалось, суть его выражается в том, что при возникновении помехи, угрожающей выполнению действия, животное прекращает основное действие и пытается уничтожить помеху. Соответствующее чувство можно определить как раздражение, более сильная его степень — злоба, а действия, вызванные ими, принято называть агрессией. Этологи в последние десятилетия много занимались изучением агрессии, справедливо полагая, что она важна и для понимания человеческих отношений. Большинство ученых сходится во мнении, что агрессия животных — это защитная реакция против любых помех, препятствующих выполнению запрограммированных инстинктов. Весь вопрос — в количественных характеристиках этой потребности. Главной сферой проявления агрессии среди животных является внутривидовая борьба. Нам кажется, что самец бросается на другого самца без всякого повода, и это трактуется как качество злобности. В действительности же самцы — конкуренты, поскольку каждый из них запрограммирован природой как потенциальная помеха программе размножения другого, и агрессия тут биологически оправдана. Как же быть с «рефлексом свободы» и агрессивностью в программах искусственного интеллекта, предназначенного для взаимодействия с людьми. Агрессивность в широком понимании слова в связи с «рефлексом свободы», видимо, полезна для ИИ. Прежде всего по той причине, что она есть у людей. Если ИИ должен иметь с ними дело, то некоторая доля агрессивности ему необходима. Создать алгоритм для реализации «рефлекса свободы» с небольшой долей агрессии не представляет труда. «Входами» могут быть любые помехи в выполнении ФА, «выходами» — новые ФА, направленные на помеху. Теперь самое время сказать несколько слов о «характере» ИИ. Прежде всего это степень «лени». Иначе говоря, значимость утомления или скуки, ограничивающая величину и длительность любого напряжения, а следовательно, и способность преодолевать сопротивление среды. Второе — характеристики СУТ: насколько она усиливает выбранные модели и тормозит все остальные, находящиеся в кратковременной памяти. Имеет значение не только ее статика, но и динамика — длительность приключения СУТ к очередной модели-«мысли». Соотношение активации и торможения от СУТ создает разные типы «характера»: «возбудимые» или «тормозные», а способность к напряжению — сильные и слабые, которые делятся еще на «импульсивные» и «уравновешенные» в зависимости от динамики напряжения. Разнообразие характеров вместе с разной значимостью врожденных чувств определяет индивидуальность личности. Разумеется, «характер», определяемый особенностями СУТ и степенью «лени», необходим ИИ. Я много занимался проблемой моделирования личности и установил значение «общественных» потребностей-чувств. У животных они составляют стадный инстинкт. Без него невозможно представить себе существование высших млекопитающих. Стадный инстинкт применительно к человеку признается не всеми учеными. Многие склонны относить социальные чувства людей целиком за счет воспитания. Я далек от биологизации человека уже просто потому, что реализация любого инстинкта у человека в значительной мере управляется общественными институтами. Кроме того, огромную роль в формировании чувств человека играют убеждения, присущие только ему. И тем не менее, существуют врожденные задатки для социальных чувств и социального поведения, неодинаковые у разных людей, и их нельзя сбрасывать со счета. Чтобы уменьшить нежелательные наследственные черты стадного инстинкта, следует просто усилить воспитание. «Человек как человек» не является темой этой книги, но проблемы создания искусственного интеллекта для использования его в человеческом обществе не позволяют совсем обойти этот вопрос. Пусть читатель воспринимает его как спорное отступление. Общественные потребности и чувства ИИ На первое место здесь нужно поставить потребность в общении. У животных она обеспечивает возможность выбора полового партнера и играет важную роль в эволюции. У человека она действует столь же сильно, как и голод: в период вынужденного одиночества возникает непреодолимое желание говорить с людьми или хотя бы видеть их. После некоторого периода общения человек устает и склонен побыть в одиночестве. Потом все повторяется снова. Для ИИ потребность в общении необходима, так как она побуждает его к контактам с людьми, без которых он не сможет познавать человеческое общество. Книг для этого недостаточно. Они не могут дать моделейобразов. Реализация потребности в общении не трудна. На «входе» «центра общения» будут действия, зрительные и словесные контакты, «выходом» явятся ФА общения. Они будут тормозиться утомлением и скукой от однообразия. Общение связано с потребностью самовыражения. О ней уже упоминалось: у животных позы и мимика выражают чувства и выполняют сигнальную функцию. У человека к этому прибавилась речь. Желание высказаться — стимул от этой потребности. При остром стремлении к общению человек жаждет хотя бы посмотреть на других людей, посмотрев, хочет послушать их, насытившись слушанием, должен высказаться, притом так, чтобы его слушали. Но это еще не конец цепочки, еще не все. Человеку свойственно стремление «командовать», навязывать свою волю ближнему. Это называют потребностью в лидерстве. Психологи отводят ей большое место в мотивах поведения людей. Соревнование и лидерство играют огромную роль в эволюции, обеспечивая улучшение вида при половом отборе. Моделирование лидерства как потребности быть первым и навязывать свою волю другим связано с теми же трудностями, что и модельное воспроизведение любознательности: «входами» является сигнальная информация, полученная из внешней среды через дистантные рецепторы. Нужно увидеть соперника, определить его действия, сравнить со своими, вывести разницу и это подать на «вход» «центра лидерства». «Выход» будет в виде стимула, который может усиливать обычную деятельность, с тем чтобы обогнать соперника или стать причиной агрессии. Таким образом, лидерство — типичный пример информационного критерия, когда деятельность определяется не «телом», а качествами внешней среды, избирательно представленной живыми существами данного вида. Нужно ли лидерство искусственному интеллекту в тех сферах деятельности среди людей, которые были перечислены выше. Мне кажется, что да, хотя бы потому, что оно есть у людей. Иерархия положений — не формальная по признакам богатства или власти, зависящая от социальной и экономической структуры общества, а та, что создается в любом коллективе, делающем общее дело, в значительной степени стимулируется лидерством. Оно — основа всякого авторитета, поскольку его приходится завоевывать. Одних способностей, знаний здесь недостаточно. Даже сильный характер, который часто сочетается с лидерством, должен получать дополнительный стимул от соревнования. Разумеется, чрезмерное стремление к лидерству — порок. Оно выражается в тщеславии и честолюбии, в эгоизме и даже жестокости. Следовательно, «центру лидерства» ИИ нужно задать соответствующие умеренные характеристики и ограничить их воспитуемость. Тогда будет исключена вероятность превращения его в диктатора. Есть в психике животных и человека потребность — чувство, противоположное лидерству. Я назвал его подчиненностью. Оно примерно соответствует понятию «конформизм». Суть его — в склонности следовать за лидером, подражать ему, подчиняться авторитету. При этом человек испытывает удовольствие. Качество подчиненности присуще в той или иной степени всем, и, видимо, уровень его находится в обратной зависимости от уровня лидерства, которым в разной степени тоже обладают все. В модельном плане механизм этой потребности — подчиняться высшему — такой же, как и механизм лидерства: результат сравнения соперника с собой является «входом» для соответствующего «центра». Весь вопрос — в характеристике «центров»: человек с сильным стремлением к лидерству откажется от соревнования и ограничится вторым местом только в том случае, если соперник обладает очень большим преимуществом; человек же со слабо выраженным стремлением к лидерству легко сдается и даже получает удовольствие от подчинения. Наблюдения над людьми все это легко подтверждают: прирожденный лидер обо всем судит самостоятельно, даже если ничего не понимает в предмете, подчиненный признает авторитетом человека, едва возвышающегося над его собственным уровнем. Моделирование подчиненности производится по тем же принципам, что и моделирование лидерства. Видимо, оно нужно для искусственного интеллекта хотя бы на период обучения. Без авторитетов трудно представить себе создание убеждений при высоком уровне сознания, когда способности к анализу поведения самого себя и окружающих развиты хорошо. Есть еще одно чувство, производное от стадного инстинкта,— это сопереживание (проще — доброта или, строже, альтруизм). Разумеется, оно должно быть присуще искусственному интеллекту, живущему среди людей. Я уже описал механизмы перевоплощения и сопереживания. Они позволяют понять психику другого лица и в какой-то степени даже испытывать его чувства. Качество «доброта» характеризует общую установку человека в его отношениях с другими. Однако трудно представить себе возможность «абсолютно доброго человека», отдающего все, всегда, всем и ничего не требующего взамен. Этот идеал, проповедуемый религиями, нереалистичен. Но что мешает нам сделать абсолютным альтруистом искусственный интеллект. Все во власти конструкторов, можно задать любые чувства и любые их характеристики. Однако как только сознание достигает определенного уровня, появляются самоорганизация и обязательное влияние общества. В этом-то все дело. Теперь нам придется разобрать этот вопрос. Сфера отношений ИИ Прежде всего отношения предусматривают существование двух или нескольких субъектов, взаимодействующих друг с другом или, точнее, обменивающихся воздействиями — материальными, энергетическими, информационными, смешанными, любыми. Мы уже рассматривали общий принцип отношений между интеллектом и средой. Интеллект воспринимает воздействия среды, анализирует их, оценивает полезность, планирует и выполняет действия, в результате которых получает «плату», удовлетворяющую потребность и изменяющую чувства. Среда при этом представлялась неопределенной. На рис. 21 среда детализирована — выделена природа, техника, модели и общество. Под последним понимается система, состоящая из интеллектов, подобных данному. Показано, что она дает информацию и получает информацию, следовательно, происходит обмен сигналами. А как же с «платой». Сигналы оцениваются и могут удовлетворять некоторые потребности (об этом мы уже говорили), например потребность в новом или потребность в лидерстве. Может статься, что существует и потребность в доброте, потребность отдавать. До сих пор потребность «отдавать» мы рассматривали в плане действий, которые сопряжены с усилиями, с напряжением. Хотя они сами по себе могут быть приятными, удовлетворяя потребность в деятельности или «рефлекс цели», но при этом не рассматривается объект действий. Его чувства не принимались во внимание. Пока не принимались. Иное дело — общественная среда, состоящая из людей, а в будущем включающая и искусственные интеллекты. В описаниях ФА было показано, что при планировании составляется модель объекта, представляющая его состояние после воздействия,— модель-цель. Для материального объекта — это его структура, измененная действием. Речевые ФА предусматривают моделирование реакций человека на сказанную фразу. Цель речевого ФА — вызвать желательные чувства у собеседника и предусмотреть свои собственные чувства в ответ на них («Я ему скажу то-то, он обрадуется, и это будет мне приятно»!). Самые простые отношения между людьми — это материальный обмен: я даю вам вещь, вы мне взамен даете другую. Предположим, что оба мы делали свои вещи сами, своим трудом. Затраченный труд измеряется утомлением и временем. То и другое измеримо мерой чувств. Мой труд — приращение чувства утомления ?Чд, где индекс «д» означает «давать». Вещь, которую я получаю взамен, удовлетворяет какую-то мою потребность и таким образом дает приращение чувства приятного ?Чп, где индекс п — «получать». Справедливым обменом я буду считать такой, когда оба приращения чувств по крайней мере равны: ?Чд = ?Чп. Втайне каждый хотел бы произвести такой обмен, чтобы ?Чп > ?Чд. Как сравниваются оба приращения чувств. Где мера. Чувства очень разные, и обмены тоже разные. За труд можно получить пищу, вещь или развлечение — все они удовлетворяют различные потребности. Сравнение идет по величине приращения по оси ординат характеристики «плата» — чувство (см. рис. 22), где отложены компоненты интегральных чувств Пр— НПр. Оба чувства легко измерить в модели ИИ. А как это делается в мозге.  Рис. 40. Схема, иллюстрирующая «условие справедливости». Показаны характеристики двух чувств: приятного ЧП от получения некоторой П «платы» и утомления ЧД, связанного с усилиями, которые нужно затратить, чтобы оправдать получение «платы». «Условие справедливости» выполняется при равном приращении чувств — ?ЧП = ?ЧД. Произведенные этологами наблюдения над животными свидетельствуют о том, что их отношения подчиняются определенным законам. Если одно проявляет благорасположение, другое не бросается в драку, а в худшем случае демонстрирует равнодушие. И наоборот: если одно обнаруживает признаки агрессии, другое отвечает тем же либо убегает. На ласку приблизительно отвечают лаской, на агрессию — сопротивлением. Похоже, что у животных есть мера сравнения чувств от «получения» и «отдавания» и критерий справедливости отношений. Не надо этому удивляться: уже немало чувств, казавшихся сугубо человеческими и привитыми обществом, обнаружено у животных. Следовательно, они имеют биологические корни. Разве мы не видим примеров альтруизма среди стадных животных. Я уж не говорю о проявлениях любви родителей к детенышам — это может наблюдать каждый. На рис. 40 показана схема, иллюстрирующая «условие справедливости». Она построена в предположении, что существует такая следящая система, которая измеряет и сравнивает чувства отношений: приращения приятного от действия «получать» и приращения неприятного от действия «отдавать». Доброту можно измерить отношением Добр = - ?ЧД / ? ЧП. У эгоиста существует психологическая установка на отношения, при которых можно давать меньше, чем получать, иными словами выигрывать в чувствах. У альтруиста, напротив, показатель доброты превышает 1. Не следует думать, что альтруизм противоречит основному закону поведения, согласно которому все действия направлены на получение прироста интегрального чувства: (Пр— НПр) > 0. Дело в том, что альтруист, затрачивая неприятное чувство, например утомление, на изготовление подарка, получает дополнительно приращение приятного от удовольствия, доставленного другому. Можно сказать, что ?ЧП = f1(«плата») + f2(?Ч другого). Человек, получивший подарок, выдаст «плату» в словах благодарности (f1 «плата»), но для альтруиста сопереживание приятным чувствам другого дает еще добавочное приращение чувства приятного (f2 (?Ч другого)). Таким образом, условие приращения суммы приятного в итоге поступка будет соблюдено. Если сказать предельно просто, то доброму доставляет удовольствие делать приятное другим людям, а эгоист равнодушен к чувствам других и за свои услуги предпочитает получать «плату» «натурой». К слову, явления сопереживания боли у животных зарегистрированы объективными средствами в опытах физиологов. Они же установили большие различия в силе этого чувства у разных особей. Если продолжить экскурс в этологию, во взаимоотношения животных, то оказывается, что отношения крайне неравномерны. К членам семьи испытываются одни чувства, несколько иные к членам своей стаи, совершенно отличные — к членам другой стаи. Получается, что по отношению к разным особям имеют место совершенно разные «коэффициенты справедливости», разное сопереживание. Чужаков всегда встречают неприязнью. Разве не то же мы видим у людей. Даже в воровской шайке, далекой от всякой морали, ее члены соблюдают своеобразную справедливость по отношению друг к другу. Модельно это выражается разными значениями «коэффициента доброты», разной установкой, что считать справедливым. Видимо, эта разница определяется степенью сопереживания: близким и приятным знакомым мы больше сопереживаем, чем чужим и враждебным нам людям. Играет роль та самая прибавка на чувства партнера по отношениям. Общеизвестно крайнее разнообразие отношений между людьми, не только чужими, но даже внутри семьи. То же касается и животных — даже сука по-разному относится к своим щенкам. Чем определяются эти различия. Можно предположить несколько факторов: 1. Биологическая близость. Она особенно выражается в близости семейной, в которой играет большую роль инстинкт продолжения рода. 2. Принадлежность к одному рабочему коллективу и к одной социальной группе. 3. Соотношение величины лидерства у вступивших в отношения людей. То же касается и подчиненности. 4. «Набор чувств», структура личности, и в частности — общительность. 5. Общность убеждений. 6. И наконец — обратная связь, самоорганизация. Пунктов перечислено много, что показывает, сколь сложны отношения между людьми. Как же быть с искусственным интеллектом. Увы, если он предназначается для человеческого общества, нет другого выхода, как моделировать в нем всю сложность исходных чувств. В частности, необходимо заложить в него «чувство справедливости», должны формироваться симпатии и антипатии, определяющие разницу в «коэффициенте доброты», разницу в значимости сопереживания близким и чужим. Другое дело, что все это при проектировании ИИ проще «дозировать» и можно задавать благоприятные характеристики. Однако и здесь не все однозначно. Осуществить азимовский главный «закон робототехники» — не вредить людям — не так просто. Он упирается в качество воспитуемости: задавать ли возможность изменения «врожденной» характеристики чувств в процессе деятельности или нет, а если да, то в какой степени. Видимо, на этот вопрос нельзя ответить однозначно, потому что возможны разные сферы деятельности ИИ в человеческой среде. Несомненно одно — нельзя допускать излишнюю самоорганизацию искусственного интеллекта, иначе он может выйти из-под контроля людей. Врожденные потребности-чувства значат для человека много, но не все. Речь и обучение создали возможность приобретать «искусственные чувства», являющиеся выражением потребностей более высокой разумной системы — общества. Как уже говорилось, убеждения — это словесные формулировки, их модели, обладающие значительной активностью и имеющие сильные связи с центрами интегральных чувств Пр — НПр. Они определяют, что можно, что должно, чего нельзя делать, что хорошо и что плохо. Содержание убеждения может быть крайне различным — от запрещения ругаться до отвлеченных идей, побуждающих их приверженцев к самоистязанию или преступлениям против общества.  Рис. 41. Схема формирования отношений и убеждений. Формирование убеждений, их изменение в течение жизни в связи с условиями существования трудно формализовать. Тем не менее я сделал такую попытку применительно к некоторому условному интеллекту. Общая схема формирования отношений и убеждений показана на рис. 41. Социальная среда условно представлена тремя источниками идей. Любых идей, которые выражаются словесными формулами, обращающимися к чувствам. Обычно источниками идей являются окружающие люди — вначале члены семьи, товарищи, учителя, потом — общественные организации, рабочие коллективы, наконец — книги. Но в данном случае не в этом дело, нас интересует схема. Понятие «воспитатель» и «воспитуемый» в равной степени относится и к ИИ. Каждый из представителей среды, человек или группа людей, имеет свои симпатии и антипатии, свое отношение к носителю интеллекта. Это отношение он высказывает словами и поступками. Пока ограничим наше рассмотрение словами. Правда, наказания «голодом» и «болью» не исключены, учитывая, что «телесные чувства» будут представлены в ИИ обязательно. На рис. 41 показаны притязания со стороны интеллекта в адрес своих оппонентов и воспитателей. Понятие это было уже дано. Повторяю: притязания подразумевают величину «платы», которую хотел бы получить интеллект от среды в ответ на свою деятельность с целью максимального удовлетворения своих потребностей. Притязания всегда превышают реальную «плату», потому что если они полностью удовлетворяются, то наступает адаптация чувства и для достижения их максимума нужно увеличивать «плату». Человек живет в условиях компромисса — его притязания всегда превышают «плату», не позволяя адаптироваться к счастью. Притязания вызывают реакцию на них со стороны адресатов, которая тоже выражается словами и поступками (представьте пример из практики воспитания детей). Первый компонент отношения интеллекта к адресату зависит от этой реакции на его притязания. Второй компонент — пожалуй, главный — определяется сравнением положения носителя интеллекта с положением соответствующих групп или лиц (снова — адресатами) с поправкой на его лидерство. Отношение высказывается, в ответ на него следует реакция, служащая обратной связью и воздействующая на отношение. Так формируется система отношений (симпатия либо антипатия) к разным источникам идей —лицам, социальным группам в зависимости от результата сравнения положений, лидерства и обратной связи. Отношения не исчерпываются только симпатиями и антипатиями, это еще и авторитеты, и их уровень. Именно они и определяют формирование убеждений. На рис. 41 все источники идей объединены «полем идей». Оно включает в себя набор словесных формул, их «адрес» (источник) и интенсивность их повторения. Иначе говоря, «поле идей» — это содержание различных убеждений, которые циркулируют в общественной среде, окружающей интеллект. Какие формулы и в какой степени усваиваются — зависит от так называемой установки. Этот термин введен психологами для обозначения изначального отношения к высказыванию (слушать ли его, воспринимать ли, либо пропускать мимо ушей, как не стоящее внимания или заведомо ложное). Установка зависит от авторитета источника и от степени совпадения содержания идеи с уже имеющимся убеждением, созданным в предшествовавшие периоды жизни интеллекта. В памяти развитого интеллекта (а мы говорим именно о таком, когда имеем дело с третьим уровнем сознания) имеется достаточный набор словесных формул, претендующих на роль убеждений,— это и есть все «поле идей» с указанием их адресатов. Некоторые из них уже стали своими убеждениями с определенной значимостью, то есть активностью и связями с чувствами. Внешнее воспитание изменяет эти убеждения на некоторую величину ?Уб, зависящую от установки и от интенсивности воздействий (например, от частоты повторения фраз и образов в средствах массовой информации). Так осуществляется постепенный «дрейф» убеждений: в зависимости от авторитета тех, кто их проповедует, и от содержания уже достигнутых ранее убеждений. Следует различать содержание убеждений и их значимость, то есть активность по сравнению с врожденными для человека или изначально заданными для ИИ чувствами. Например, можно принимать заповеди религии, но не придавать им особенного значения, и тогда они не могут конкурировать с потребностями, производными от инстинктов. Убеждения и заданные чувства соединены прямыми и обратными связями: убеждения могут усиливать или тормозить чувства, а те в свою очередь участвуют в формировании убеждений. Проще всего внедрить в сознание те словесные формулы, которые совпадают с насущными потребностями. И наоборот, чем абстрактнее формулы, тем труднее их сделать значимыми убеждениями. Очень сложно формализировать «поле идей», что необходимо при создании ИИ. В самом деле, существует огромное множество словесных формул, приобретающих значимость чувств, их трудно вместить в модель. Мне кажется, что нужно установить основные направления идей, сопоставить им специальные шкалы, выбрать на каждой шкале противоположные точки и приписать им численные значения со знаками + и —. Тогда промежуточную точку можно определять как координату по данному убеждению. Число таких шкал в первом приближении должно соответствовать основным чувствам: жадности, страху, общению, доброте, стремлению к лидерству, любознательности, лени. Люди тоже создают идеи по всем этим чувствам, и общество внушает их своим гражданам, формируя у них убеждения. Не буду разбирать особенности построения шкал по каждому убеждению, это относится к задаче моделирования общественных систем. В качестве примера можно сослаться на «шкалу жадности». Координаты со знаком « + » характеризуют убеждения, связанные с отказом от вещей, координаты со знаком «—» характеризуют убеждения, оправдывающие собственность. Следует остановиться на убеждениях, связанных со справедливостью — они, пожалуй, самые важные. Что считать справедливым. Мы уже обсуждали этот вопрос и ввели понятие условия справедливости (см. рис. 40). Обсуждаемые убеждения устанавливают эквиваленты обмена или «ранг ценностей» — труд, власть, вещи, информация. Фактически справедливость сводится к словесным формулам обмена: «что, кому, за что и сколько» давать, «от кого, что, сколько и за что» брать. Формализацию убеждений для модели ИИ можно осуществить путем введения системы координат с нанесенными на них несколькими вариантами точек. Каждый вариант отражает убеждения, исходящие из определенного источника идей. Собственные убеждения искусственного интеллекта также будут представлены точками на сетке координат. Убеждения формируются согласно схеме, показанной на рис. 38, как функция воспитания. Однако это происходит лишь в «детстве и юности» искусственного интеллекта, то есть в период его обучения. Приходит время, и уровень сознания ИИ повышается настолько, что он становится способным моделировать отдельно действия, высказывания, чувства и мысли — свои и других лиц (мысли и чувства других — по косвенным признакам их речи и мимики). Тогда наступает время самоорганизации или применительно к убеждениям — время самовоспитания. Убеждения (точки в упомянутой системе координат), высказываемые различными адресатами, сравниваются с их действиями и вводится поправка на справедливость (искренность). Образование и накопление знаний изменяют баланс состояний, и авторитеты падают. Устанавливается уровень «биологических», то есть изначально заложенных чувств, и они влияют на пошатнувшиеся убеждения. Накапливается собственный опыт действий как по «убеждениям», так и по врожденным потребностям, отмечается уровень душевного комфорта, сопровождавший эти действия. Все это вносит коррективы и смещает точки в системе координат, чаще в сторону изначально заложенных чувств. Происходит «эрозия убеждений». Но может произойти и обратный процесс: действия по убеждениям усиливают их модели, они становятся более значимыми и меняют «ранг ценностей» в сторону идеалов. Знания, чувства, убеждения, характер и отношения к окружающим искусственного интеллекта делают его индивидуальностью, личностью, причем личностью социальной. Высокий уровень сознания выводит его за пределы объекта простых манипуляций со стороны воспитателей. И здесь возникает ряд вопросов. Нужны ли убеждения для искусственных интеллектов. Они нужны, во всяком случае для той их разновидности, которую мы обсуждаем, то есть для предназначенных для деятельности среди людей и в помощь людям. В речевом поведении в значительной мере они заменяют чувства. Нужны ли воспитуемость, самоорганизация и тем более — самовоспитание. Этот вопрос гораздо сложнее. «Законы робототехники» очень логичны, хотя и трудно выполнимы при высоком уровне сознания и большом объеме знаний. Формирование личности искусственного интеллекта будет проходить ускоренными темпами, так же как и обучение. Следовательно, можно довольно жестко задать характеристики изначально заложенных потребностей и в короткий срок создать у него желательные для людей убеждения. Последующая возможность их изменений в результате анализа действительности и собственной деятельности, к сожалению, не может быть заблокирована. Однако жесткие основные чувства, такие, как альтруизм, общительность, должны обезопасить людей от чрезмерной увлеченности искусственного интеллекта своими вновь изобретенными идеями. Еще одной гарантией безопасности должны быть ограничения тренированности моделей или их максимальной активности. Это средство против излишней увлекаемости и в то же время условие психической нормальности ИИ. О возможности психических заболеваний уже была речь. Как упоминалось, искусственный интеллект такого уровня сознания и образования представляет собой личность. Людям придется с этим считаться и рассматривать его как равного. Это будет существо, чувствующее так же, как и человек, только еще умнее, поскольку он будет обладать гораздо более совершенной памятью. Поведение такого существа можно представить себе как выражение общей программы всех интеллектов: выбор и смена деятельности с целью получения максимума УДК в каждый данный момент. Это вовсе не значит, что счастье данного момента будет законом его деятельности. Как умный человек планирует длительные ФА и живет будущими их результатами, а в настоящем напрягается и ограничивает себя, так же будет жить и искусственный интеллект. Чем он будет заниматься. Тем же, чем и люди: по «расписанию» внешней среды выполнять свои социальные обязанности, то есть работать, а в остальное время — развлекаться, учиться, общаться с людьми или другими искусственными интеллектами. Еще один вопрос: можно ли будет корректировать искусственный интеллект в процессе его деятельности для людей, если она окажется сомнительной. Например, изменить активность тех или иных чувств. Можно, но только при одном условии — его собственном согласии. Здесь мы сталкиваемся с моральными и этическими проблемами. Искусственный интеллект третьего уровня сознания придется рассматривать как существо со всеми правами человека. Нервнобольных лечат, но только тогда, когда они этого хотят сами. Психически больных лечат без их согласия, по просьбе родственников, врачей, общественных организаций. Точно так же должно обстоять дело и с искусственным интеллектом. Его право на жизнь будет таким же, как у людей. «Выключить» его можно будет только по приговору суда... Странные проблемы возникнут! Боюсь, что серьезный читатель обвинит меня в излишнем воображении и соскальзывании с научных позиций на банальную фантастику. Это не так. Все, о чем я пишу, почти так же реально, как использование термоядерной энергии в мирных целях: никто не сомневается, что это возможно, а дело пока стоит, упирается в технологические трудности. Я уверен, что алгоритм интеллекта вполне возможен в самых высших его проявлениях и что создание технологии для этого тоже возможно. К сожалению, одной уверенности здесь недостаточно, пока не вырисуются перспективы практической реализации такого алгоритма. Общество искусственных интеллектов Никак не обойтись без этой главы, выглядящей еще более фантастично и несолидно для научной книги. Речь пойдет об обществе (или поскромнее — коллективе) ИИ. Не нужно удивляться: это перспектива не безнадежно далекая — в пределах жизни молодых (40—50 лет). Первая возможность — взаимодействие ИИ, созданных для помощи людям. Вторая — колонии роботов-интеллектов на планетах. Наверное, это будет проще, чем заселять их людьми,— очень уж хрупка наша живая плоть. Зададим сначала вопрос: в чем будет «смысл жизни» искусственных интеллектов. А в чем смысл жизни людей. Нет, я отнюдь не собираюсь философствовать. Модельное представление об интеллекте ставит вопрос совсем в другой плоскости. Жизнь отдельного человека — это деятельность, поведение, поступки, в том числе и речевые. Это иерархия и сеть ФА, направленных на удовлетворение биологических потребностей, измененных общественным воспитанием, социальных потребностей — убеждений, целиком привитых обществом. Такая деятельность имеет эгоистическую направленность, в лучшем случае — на собственное потомство и непосредственное окружение. Деятельность индивидуума, личности, живущей по убеждениям, является проявлением жизни общества, так же как деятельность клетки хотя и самостоятельна, но целиком зависит от целого организма и служит его функциям. Чем больше прогрессирует человечество, тем дальше в будущее нацеливается жизнь общества, тем шире становится круг связей государств и людей. Таким образом, и деятельность каждого человека — его ФА — все более утрачивает эгоистическую направленность, и смысл его жизни (хотя и не осознаваемый) смещается к служению обществу, как высшей системе. Относительно недавно для большинства людей главным объектом приложения их деятельности была природа. Жизнь состояла из непосредственного добывания пищи и защиты от врагов — холода, зверей. Правда, люди уже давно объединились для борьбы с природой, но общение между ними играло подсобную роль. Теперь все изменилось совершенно. Главным объектом деятельности большинства людей в высокоразвитых странах являются сами люди и созданная ими техника. Непосредственно с природой общается только несколько процентов населения, но и те — чаще при помощи техники, чем прибегая к собственной мышечной силе. Содержанием жизни большинства стали общественные отношения. Если самый глубокий смысл жизни — в его модельном выражении — остался таким же: стремление к максимуму уровня душевного комфорта, то компоненты, его составляющие, стали иными. Подавляющая часть потребностей теперь удовлетворяется через отношения людей. Мы даже мыслим больше словами, чем образами. Все это я говорю для того, чтобы подойти к смыслу жизни искусственных интеллектов как членов общества. Пока они будут вкраплены в человеческое общество, они будут жить смыслом человеческой жизни. Представьте себе общество бесполых людей — это совсем не так трудно вообразить. Людям было бы достаточно занятий, развлечений и удовольствий и за пределами инстинкта размножения. По условиям возрастным и социальным многие живут такой «бесполой» жизнью. Так же, теми же стимулами будут жить среди нас искусственные интеллекты. Будут ли они счастливее нас, людей, зависит от того, как их спроектировать. Уже говорилось о том, что есть некоторые непреложные законы деятельности интеллекта, обязательный набор потребностей, свойств, в том числе скука и адаптация, без которых ИИ невозможен, но которые не позволят ему быть безоблачно счастливым. Предположим, поставлена задача создать роботов с интеллектом, которыми нужно заселить планету, причем так, чтобы колония могла жить самостоятельно и развиваться без связи с людьми и Землей. Основное требование одно — прогресс, возрастание и развитие общества в целом. Другое требование (сомнительное и спорное) — члены общества должны быть по возможности счастливы: с некоторым достаточным УДК, со сравнительно небольшим его разбросом среди групп «населения». Как для таких ИИ спроектировать интеллект — вопрос не главный. Он может действовать только по одним законам, если говорить о развитом интеллекте, с третьим уровнем сознания. Эти законы были обсуждены выше. Вопрос — в потребностях и чувствах, которые будут двигать интеллектом, в качествах, которые нужно ему придать, чтобы общество удовлетворяло требованию прогресса и устойчивости. Вернемся к смыслу жизни — уже для членов колонии ИИ. Борьба с природой. Да, борьба останется. Нужны энергия и материалы для того, чтобы воспроизводить самих роботов, огромную техносферу, обеспечивающую получение этих материалов и энергии. Прогресс общества — в науке, а она материальна. Уж ктокто, а ученые знают, что наука может поглотить сколь угодно техники и энергии. Следовательно, будет большая и очень разносторонняя «материальная» в буквальном смысле слова деятельность. Ей обязательно сопутствует или даже предваряет ее информационная индустрия, тоже требующая материальных средств. Другие точки приложения сил для ИИ будут примерно такими же, как и у нас. Общение. Искусство воспитания новых поколений. Поглощение информации. Сопротивление старению и болезням. Впрочем, последняя проблема будет выглядеть иначе, чем у людей, хотя и не исчезнет совсем. Вот и все аспекты смысла жизни. Все это возможно только в очень развитом технологическом обществе. Сложность его, если включить науку, будет очень велика. Можно ли рассчитывать, что эта сложность вместится в интеллект каждого члена колонии роботов. Думаю, что нельзя. Внешняя память — библиотеки информации и программ — будет доступна всем, а вот собственная память не может содержать всех моделей. Общество в целом должно быть гораздо умнее своих членов. Еще одно условие, вытекающее из разнообразия и сложности,— технологическое неравенство членов общества. Одни должны будут выполнять одну работу, другие — другую. Если невозможно вместить все модели в интеллект каждого, то потребуются «специалисты». Другой вытекающий из этого вопрос: может быть, следует проектировать разных роботов —- «элиту», «рабов»... Не думаю. «Рабами» должны быть машины с элементарным интеллектом без всяких признаков самоорганизации, но, возможно, с некоторым самым низким уровнем сознания. Такое же положение, как теперь с рабочим скотом. Машины будут даже еще гораздо ниже — просто умные автоматы. (Уверен, что уровень сознания высших млекопитающих, к примеру, собак, лошадей, живущих с людьми, не так уж низок и мы повседневно нарушаем их «права»). Но как только создадут ИИ, способный к обучению, уже невозможно будет удержать его на уровне «раба». Поэтому самое разумное для удовлетворения второго требования (обеспечить достаточный УДК членов колонии) — это «врожденное равенство» интеллекта. Может быть, полная идентичность. Не думаю. Нужно разнообразие, обеспечивающее различия в интеллектуальной деятельности, но не более. Нельзя примирить большое неравенство, способность к сопереживанию, высокий уровень сознания и высокий УДК! Попытаемся представить себе необходимый набор потребностей-чувств, который будет достаточен, чтобы обеспечить прогресс, высокий УДК членов колонии и устойчивость системы. Одно условие уже высказано — набор чувств одинаков у всех, а значимость их различается у индивидов в некоторых допустимых пределах. Эти пределы еще требуют проработки на моделях. Потребность самосохранения несомненно останется, как уже доказывалось применительно к искусственным интеллектам, назначение которых — служба людям. Нужен «страх» и нужен «голод», так как возможна трудная жизнь, с опасностями. Нужны эмоции с некоторыми ограничениями пределов. Рабочие потребности уже несколько раз перечислялись. Вот они еще раз: любознательность и потребность поиска, потребность действовать и доводить ФА до конца — «рефлекс цели», «рефлекс свободы». Потребность в отдыхе и расслаблении как реакция на напряжение и однообразие. Интегральные чувства Пр — НПр обязательны. Именно по ним интеллект оптимизирует свою деятельность. Такие качества, как адаптация и способность моделей и связей к тренировке, предопределяющие самоорганизацию, являются непременной принадлежностью всякого развитого интеллекта. Самый спорный вопрос — это общественные чувства и потребности. Как было бы хорошо представить себе благополучное общество, в котором «граждане» с искусственным интеллектом лишены всех пороков, портящих людям жизнь. Однако будет ли состоящее из таких «граждан» общество удовлетворять требованиям прогресса, «счастья» и устойчивости — в условиях исключительной сложности среды и структуры самого общества. Рассмотрим вопрос о лидерстве и подчиненности. Несомненно, деятельность будет коллективной, поскольку сложность среды во много раз превысит моделирующие возможности каждого из ИИ. Следовательно, моделирование будет осуществляться с упрощениями, а значит, и с искажениями, вызванными субъективностью. Субъективность, ограниченность ведут к разногласиям в оценках. При этих условиях эффективная деятельность коллектива возможна только при наличии руководителя, лидера. Назначение его из числа равных не решает проблемы: нужен авторитет, только тогда коллектив работоспособен. Как ни рассуждай, но без потребности руководить и подчиняться, выраженной в разной степени у членов любого сообщества, работоспособный коллектив невозможен. Итак, эти потребности необходимы. Лидерство должно сочетаться с повышенными способностями, подчиненность — со способностями поскромнее. Тогда все станет на свои места. Однако — при одном условии: лидерство должно быть ограничено. Нужно задать такие характеристики и так лимитировать тренируемость центров, то есть способность изменяться в результате самовоспитания, чтобы не развился диктатор. Есть в арсенале чувств противоядие против излишнего лидерства — это сопереживание, альтруизм (доброта) и потребность в общении, чувство справедливости и правды. Вместе взятые, они дают достаточную основу для правильной морали, которая должна детализироваться убеждениями, привитыми воспитанием. Если при проектировании ИИ соблюсти баланс между потребностями, способными перерасти в пороки, разъединяющие «граждан», и потребностями, их объединяющими, то можно приблизиться к идеалу. Приблизиться, но не достигнуть полной гармонии, потому что тогда наступит застой. Видимо, нужно предусмотреть достаточное разнообразие интеллектов. Конечно, это породит противоречия, но без противоречий нет прогресса. Интересны проблемы воспитания, образования и последующего самовоспитания ИИ. Несомненно, нельзя сразу изначально задать все чувства, убеждения, память, воспоминания, которые определяют личность. В то же время нелогично заставлять «искусственного ребенка» проделывать самостоятельно и медленно весь цикл естественного развития в обществе, подвергаясь случайностям и опасностям неправильного направления самоорганизации. Безусловно, многое нужно задать в первичной структуре — в связях с высокой проходимостью и в характеристиках элементов, например в виде «центров» потребностей и чувств. Это врожденные, «генетические» программы. Последующее развитие следует организовывать в виде обучения и общения, в процессе которого в соответствии с условиями общества должна формироваться личность с особенностями, определяемыми ее врожденными качествами, Ясности в этом вопросе нет. Можно ли на этот период задать специальные условия образования связей, обеспечивающие быстрое обучение и формирование убеждений. Хотя на первый взгляд кажется, что все в нашей власти, но это не совсем так. Трудно представить, например, оперативную память с необозримым объемом или возможность изменения свойств элементов — все это ограничено технологией. У животных и человека усвояемость в детстве выше, чем у взрослого, но еще не ясно, как это осуществить для ИИ. Одно несомненно, что образование и воспитание «искусственных детей» можно запрограммировать гораздо жестче, чем для человеческих, тем более, что они не будут ограничены рамками роста «тела». Жизнь человека и даже исторические периоды человечества очень коротки по сравнению с эволюцией природы. И ничего пока сделать не удается для ее ускорения. «Генная инженерия» — не утопия, но возникающие здесь проблемы гораздо сложнее, чем представляем мы это сегодня. Для целенаправленной переделки генотипа человека нужна его кибернетическая «действующая модель» огромной сложности. Это значительно труднее, чем создать искусственный интеллект. Опыт развития науки и техники показал, что люди не повторяют природу, а изобретают новые решения. Уверен, что проще сделать «нового человека», чем переделывать имеющегося. Не приведет ли высокий уровень технологий к искушению быстрой переделки природы «граждан» искусственного общества. Не обусловит ли это его нестабильность. Разумеется, сейчас не стоит серьезно обсуждать этот вопрос, но такая опасность возможна. Консерватизм необходим, потому что явления, происходящие в системах «типа живых» — в организме и обществе, слишком сложны и их отражение в разуме типа человеческого весьма ограниченно и субъективно. Однако уже оформляется модельный подход к сложности, который позволяет исправить недостатки разума. Нет сомнения, что будущее общество предусмотрит опасности неконтролируемой самоорганизации. Фантастична и увлекательна проблема искусственного интеллекта, поэтому меня и занесло так далеко — до разговора об искусственном обществе. Вернемся к вопросам теории интеллекта. |

|

||

|

Главная | В избранное | Наш E-MAIL | Добавить материал | Нашёл ошибку | Другие сайты | Наверх |

||||

|

|

||||